Die Augen am Himmel: KI-gesteuerte Sichtsysteme in Drohnen der nächsten Generation

Drohnen sind in der Unterhaltungsbranche (TV-Shows/Filme), bei Hobbyfotografen und als Spielzeug weit verbreitet. Sie werden zunehmend in den Bereichen Inspektion, Logistik/Lieferung, Sicherheit und Überwachung sowie in anderen industriellen Anwendungsfällen eingesetzt, da sie schwer zugängliche Bereiche erreichen können. Aber wussten Sie, dass die wichtigste Komponente für den Betrieb einer Drohne ihr Sichtsystem ist? Bevor wir uns näher mit diesem Thema befassen, wollen wir zunächst erkunden, was Drohnen sind, welche unterschiedlichen Anwendungen es gibt und warum sie immer beliebter geworden sind. Schließlich werden wir erörtern, wie onsemi transformiert die Bildverarbeitungssysteme, die diese unglaublichen Flugobjekte antreiben.

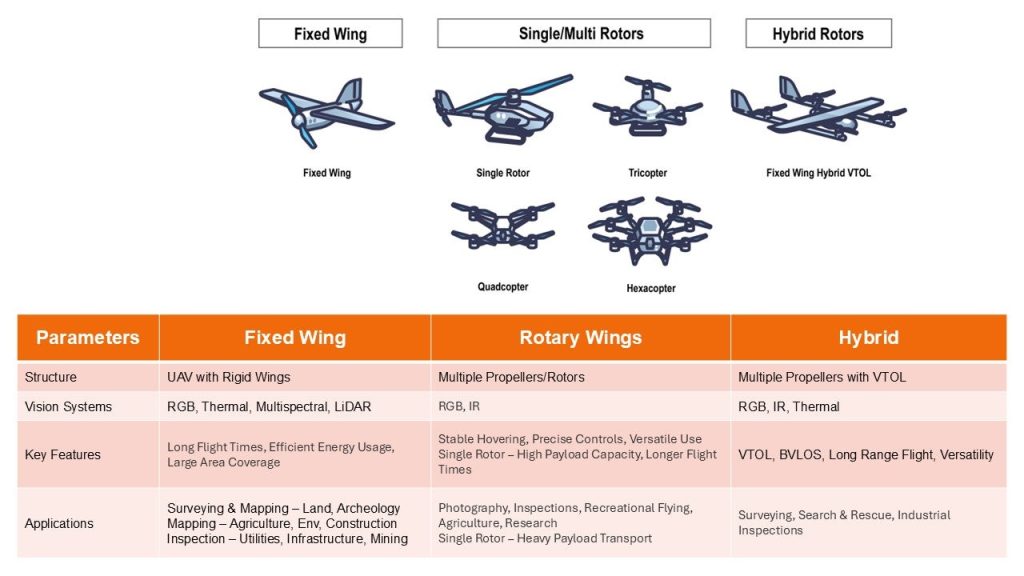

Typen und Anwendungen

Drohnen sind unbemannte Luftfahrzeuge (UAV), auch unbemannte Luftfahrtsysteme (UAS) genannt, und in geringerem Maße auch ferngesteuerte Luftfahrzeuge (RPA). Sie können ohne Antrieb operieren und mit verschiedenen Systemen autonom navigieren.

Es gibt drei Arten von Drohnen: Starrflügeldrohnen, Einrotor-/Mehrmotordrohnen und Hybriddrohnen. Jede dient einem anderen Zweck, und jeder Typ ist auf den beabsichtigten Zweck ausgerichtet, für den er gebaut wurde.

Feste Tragflächen werden in der Regel für den Transport schwerer Nutzlasten und längere Flugzeiten verwendet und kommen bei Aufklärungs-, Überwachungs- und Aufklärungsmissionen (ISR), Kampfeinsätzen und Streumunition, Kartierungs- und Forschungsaktivitäten zum Einsatz, um nur einige zu nennen.

Einzel-/Multi-Rotoren haben die vorherrschende Verwendung, mit einer Vielzahl von industriellen Schwerpunkten, die von normalen Lagern bis zu Inspektionen und sogar als Lieferfahrzeuge reichen. Der Zweck dieser Typen kann vielfältig sein, da sie in einer Vielzahl von Anwendungsfällen eingesetzt werden können und hoch optimierte elektro-mechanische Lösungen erfordern.

Hybrid-Rotoren vereinen das Beste aus beiden oben genannten Typen und verfügen über eine vertikale Start- und Landefähigkeit (VTOL), die sie vielseitig einsetzbar macht, insbesondere in Regionen mit begrenztem Raum. Die meisten Lieferdrohnen nutzen diese Fähigkeiten aus offensichtlichen Gründen.

Bewegungs- und Navigationssysteme in Drohnen

Drohnen verfügen über eine Vielzahl von Sensoren für Bewegung und Navigation, darunter Beschleunigungsmesser, Gyroskope und Magnetometer (zusammenfassend als Inertialmesseinheit oder IMU bezeichnet), Barometer und mehr. Sie verwenden eine Vielzahl von Algorithmen und Techniken wie Optical Flow (unterstützt durch Tiefensensoren), Simultaneous Localization and Mapping (SLAM) und Visual Odometry. Obwohl diese Sensoren ihre Aufgaben gut erfüllen, haben sie oft Schwierigkeiten, die erforderliche Genauigkeit und Präzision zu erschwinglichen Kosten und in optimaler Größe zu erreichen. Das Problem wird bei längeren Flugzeiten noch verschärft, was dazu führt, dass teure Batterien benötigt werden oder die Flugzeiten aufgrund von Batterieladezyklen begrenzt sind.

Bildverarbeitungssysteme in Drohnen

Bildsensoren ergänzen die oben genannten Sensoren mit erheblichen operativen Verbesserungen, die zu einer hochgenauen, hochpräzisen Maschine führen. Es gibt zwei Arten von Sensoren - kardanische Aufhängungen (oft auch als Nutzlasten bezeichnet) und Bildnavigationssysteme (VNS).

Kardanische Aufhängungen* - Sie bestehen in der Regel aus verschiedenen Arten von Bildsensoren, die das gesamte elektromagnetische Spektrum abdecken (Ultraviolett in Ausnahmefällen, normale CMOS-Bildsensoren über 300nm - 1000nm, kurzwellige Infrarotsensoren (SWIR) bis 2000nm und über 2000nm hinaus mit mittelwelligen (MWIR) und langwelligen Infrarotsensoren (LWIR).

Bildgebende Navigationssysteme (VNS) - Sie bestehen in der Regel aus preiswerten Bildsensoren mit geringer Auflösung und nutzen zusammen mit den Daten der IMU und der Sensoren Computer-Vision-Techniken, um eine umfassende Lösung für die autonome Navigation zu schaffen.

Die Bedeutung von Vision Systems

Drohnen werden sowohl in Innenräumen als auch im Freien eingesetzt, wie die oben beschriebenen Anwendungen zeigen. Diese Bedingungen können aufgrund der unterschiedlichen Beleuchtung und der eingeschränkten Sicht bei Staub, Nebel, Rauch und stockfinsterer Umgebung eine große Herausforderung darstellen. Diese Systeme versuchen, die Algorithmen der künstlichen Intelligenz (KI) und des maschinellen Lernens (ML), die auf Bilddaten angewendet werden, zu nutzen und gleichzeitig die Daten zu verwenden, die von den zuvor erwähnten Techniken bereitgestellt werden, und das alles im Zusammenhang mit dem Betrieb eines hoch optimierten Fahrzeugs, das wenig Energie verbraucht und lange Strecken oder lange Flugzeiten ermöglicht.

Es ist unerlässlich, dass die in diese Algorithmen eingegebenen Daten eine hohe Genauigkeit und einen hohen Detaillierungsgrad aufweisen und in bestimmten Anwendungsfällen genau das liefern, was benötigt wird, um eine effiziente Verarbeitung zu ermöglichen. Die Trainingszeiten bei der KI/ML-Nutzung müssen kurz sein, und die Schlussfolgerungen müssen schnell und mit hoher Genauigkeit und Präzision erfolgen. Die Bilder müssen unabhängig von der Umgebung, in der die Drohne operiert, von hoher Qualität sein, um die oben genannten Anforderungen zu erfüllen.

Sensoren, die lediglich die Szene erfassen und zur Verarbeitung weiterleiten, reichen bei weitem nicht aus, um einen qualitativ hochwertigen Betrieb dieser Maschinen zu ermöglichen, was in den meisten Fällen den eigentlichen Zweck ihres Einsatzes zunichte macht. Die Fähigkeit zur Verkleinerung bei voller Detailgenauigkeit in interessanten Bereichen, ein großer Dynamikbereich, um helle und dunkle Lichtverhältnisse im selben Bild zu erfassen, die Minimierung/Entfernung von parasitären Effekten in Bildern, staub-, nebel- und rauchgefüllte Sichtfelder und die Unterstützung dieser Bilder mit einer hohen Tiefenauflösung bieten enorme Vorteile, um UAVs zu hoch optimierten Maschinen zu machen.

Diese Fähigkeiten minimieren den Umfang der Ressourcen - Rechenkerne, GPUs, Speicher auf dem Chip oder außerhalb des Chips, Busarchitekturen und Energiemanagement -, die für die Rekonstruktion und Analyse dieser Bilder erforderlich sind, und beschleunigen den Entscheidungsprozess. Dies senkt auch die Stücklistenkosten des Gesamtsystems, insbesondere wenn man bedenkt, dass die heutigen UAVs leicht mehr als 10 Bildsensoren beherbergen können. Alternativ können bei gleichem Ressourceneinsatz mehr Analysen und komplexe Algorithmen zur Unterstützung einer effektiven Entscheidungsfindung ermöglicht werden, wodurch sich das UAV in diesem überfüllten Feld abhebt.