Ojos en el cielo: Sistemas de visión basados en IA para drones de nueva generación

Los drones se han generalizado en el mundo del entretenimiento (programas de televisión y películas), la fotografía de aficionados y como juguete. Cada vez se utilizan más en inspección, logística/entrega, seguridad y vigilancia y otros usos industriales, gracias a su capacidad para acceder a zonas de difícil acceso. Sin embargo, ¿sabía que el componente más crítico para el funcionamiento de un dron es su sistema de visión? Antes de profundizar en este tema, vamos a explorar qué son los drones, sus diversas aplicaciones y por qué han aumentado su popularidad. Por último, hablaremos de cómo onsemi está transformando los sistemas de visión que impulsan estos increíbles objetos voladores.

Tipos y aplicaciones

Los drones son vehículos aéreos no tripulados (UAV), también llamados sistemas aéreos no tripulados (UAS) y, en menor medida, aeronaves pilotadas a distancia (RPA). Pueden operar sin necesidad de ser conducidos y navegar de forma autónoma utilizando diversos sistemas.

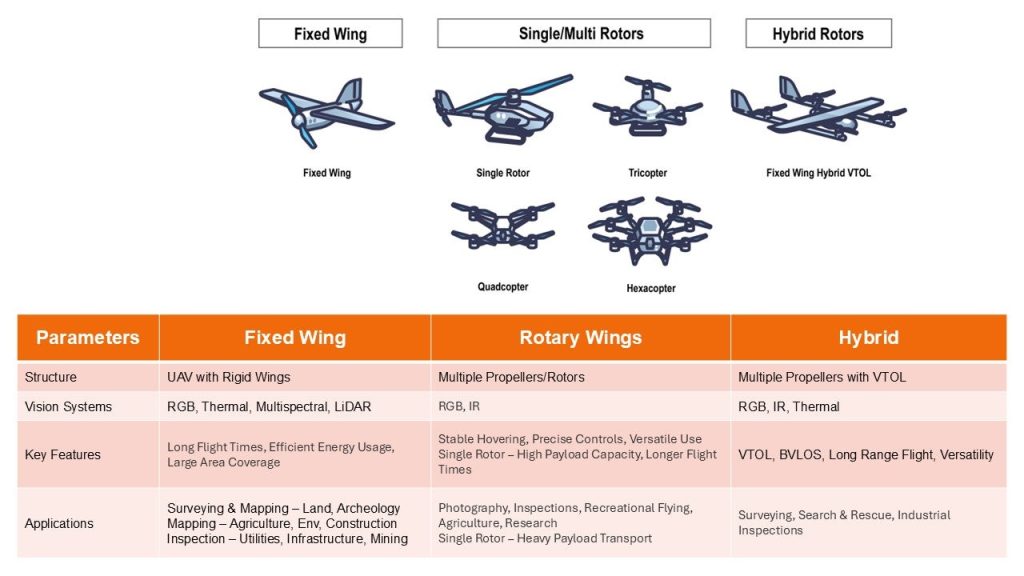

Existen tres tipos de drones: de ala fija, monorotor/multirrotor e híbridos. Cada uno de ellos sirve para un propósito diferente, y cada tipo está alineado con el propósito previsto para el que se construye.

Alas fijas se utilizan normalmente para el transporte de cargas útiles más pesadas, tiempos de vuelo más largos y se despliegan en misiones de inteligencia, vigilancia y reconocimiento (ISR), operaciones de combate y municiones de merodeo, cartografía y actividades de investigación, por mencionar algunas.

Monorotor/Multirrotor tienen el uso dominante, con una amplia variedad de enfoques industriales que van desde los almacenes habituales a las inspecciones e incluso como vehículos de reparto. La finalidad de estos tipos puede ser variada, ya que pueden desplegarse en una gran variedad de casos de uso y exigen soluciones electromecánicas muy optimizadas.

Rotores híbridos incorporan lo mejor de los dos tipos anteriores y tienen una capacidad de despegue y aterrizaje vertical (VTOL) que los hace versátiles, especialmente en regiones con limitaciones de espacio. La mayoría de los drones de reparto aprovechan estas capacidades por razones obvias.

Sistemas de movimiento y navegación en drones

Los drones llevan multitud de sensores de movimiento y navegación, como acelerómetros, giroscopios y magnetómetros (denominados colectivamente unidad de medición inercial o IMU), barómetros y otros. Utilizan diversos algoritmos y técnicas, como el flujo óptico (asistido con sensores de profundidad), la localización y mapeo simultáneos (SLAM) y la odometría visual. Aunque estos sensores desempeñan bien sus funciones, pueden tener dificultades para alcanzar la exactitud y precisión necesarias a costes asequibles y tamaños óptimos. El problema se agrava aún más durante los vuelos de larga duración, lo que obliga a utilizar baterías caras o a limitar los tiempos de vuelo en función de los ciclos de carga de las baterías.

Sistemas de visión en drones

Los sensores de imagen complementan a los anteriores con importantes mejoras operativas que dan como resultado una máquina de gran precisión y exactitud. Están disponibles en dos tipos: cardanes (a menudo denominados también cargas útiles) y sistemas de navegación por visión (VNS).

cardanes* - proporcionan visión en primera persona (FPV); generalmente están constituidos por diferentes tipos de sensores de imagen que abarcan todo el amplio espectro electromagnético (ultravioleta en casos excepcionales, sensores de imagen CMOS normales de más de 300nm - 1000nm, sensores infrarrojos de onda corta (SWIR) que se extienden hasta 2000nm y más allá de 2000nm con sensores infrarrojos de onda media (MWIR) y de onda larga (LWIR).

Sistemas de navegación por visión (VNS) - proporcionan orientación para la navegación y evitan objetos y colisiones; suelen estar formados por sensores de imagen de baja resolución y bajo coste y, junto con la IMU y los datos de los sensores, utilizan técnicas de visión por ordenador para crear una solución integral para la navegación autónoma.

Importancia de los sistemas de visión

Los drones operan tanto en interiores como en exteriores, como se ha visto en los usos y aplicaciones descritos anteriormente. Estas condiciones pueden ser muy complicadas, con grandes variaciones de iluminación y limitaciones de visibilidad en entornos de polvo, niebla, humo y oscuridad total. Estos sistemas intentan aprovechar algoritmos significativos de inteligencia artificial (IA) y aprendizaje automático (ML) aplicados sobre datos de imagen, al tiempo que utilizan la ayuda de los datos proporcionados por las técnicas mencionadas anteriormente, todo ello en el contexto de la operación de un vehículo altamente optimizado que consume poca energía y realiza operaciones de larga distancia o de tiempo de vuelo prolongado.

Es imperativo que los datos introducidos en estos algoritmos sean de alta fidelidad y muy detallados, pero que en determinados casos de uso proporcionen justo lo que se necesita, permitiendo así un procesamiento eficiente. Los tiempos de entrenamiento en el uso de IA/ML deben ser cortos, y la inferencia debe ser rápida con gran exactitud y precisión. Para cumplir estos requisitos, las imágenes deben ser de alta calidad, independientemente del entorno en el que opere el dron.

Los sensores que se limitan a capturar la escena y presentarla para su procesamiento se quedan muy cortos a la hora de permitir el funcionamiento de alta calidad de estas máquinas que, en la mayoría de los casos, anularán el propósito mismo de su despliegue. La capacidad de reducir la escala sin perder detalle en las regiones de interés, ofrecer un amplio rango dinámico para hacer frente a las condiciones de luz brillante y oscura en el mismo fotograma, minimizar/eliminar cualquier efecto parásito en las imágenes, hacer frente a los campos de visión llenos de polvo/niebla/humo y ayudar a estas imágenes con una alta resolución de profundidad ofrecen enormes beneficios para hacer de los UAV una máquina altamente optimizada.

Estas capacidades minimizan la magnitud de los recursos -núcleos de procesamiento, GPU, memoria dentro o fuera del chip, arquitecturas de bus y gestión de la energía- necesarios para reconstruir y analizar estas imágenes y acelerar el proceso de toma de decisiones. Esto también reduce el coste de la lista de materiales del sistema global, sobre todo si tenemos en cuenta que los vehículos aéreos no tripulados actuales pueden albergar fácilmente más de 10 sensores de imagen. Por otra parte, con el mismo conjunto de recursos, se pueden realizar más análisis y algoritmos complejos que ayuden a tomar decisiones eficaces, lo que hace que el UAV se diferencie en este campo tan saturado.